La confiance ne peut être automatisée : les syndicats de l’éducation façonnent l’avenir de l’IA

Partout dans le monde, l’intelligence artificielle est rapidement intégrée dans les systèmes éducatifs. Les gouvernements et les entreprises technologiques promettent l’efficacité, l’« apprentissage personnalisé» et la prise de décision fondée sur les données. Pour les enseignant·e·s et leurs syndicats, toutefois, l’IA soulève des questions bien plus fondamentales : qui contrôle l’éducation ? Qu’advient-il de l’autonomie professionnelle, de la responsabilité démocratique, de l’équité et des droits des travailleur·euse·s lorsque des algorithmes interviennent dans l’enseignement et l’apprentissage ?

Pour s’attaquer à ces enjeux et définir une vision syndicale d’un avenir centré sur l’humain, l’Internationale de l’Éducation a réuni plus de 200 dirigeant·e·s syndicaux·ales, éducateur·trice·s et expert·e·s de toutes les régions à l’occasion de sa première conférence mondiale sur l’intelligence artificielle, intitulée« Façonner notre avenir : les syndicats de l’éducation pour une IA centrée sur l’humain », les 4 et 5 décembre, à Bruxelles. Deux jours durant, les participant·e·s ont examiné comment l’intelligence artificielle refaçonne l’éducation et le travail, et ce que les syndicats peuvent faire pour que ces systèmes renforcent, plutôt que de saper, l’enseignement public, la démocratie et la profession enseignante.

Si la technologie est l’outil, l’humanité est l’auteure

Lors de l’ouverture de la conférence, les syndicats belges ont souhaité la bienvenue aux participant·e·s à Bruxelles dans une allocution conjointe qui a dépassé les frontières linguistiques, démontrant comment les syndicats d’un pays multilingue travaillent de concert pour aborder la question de la gouvernance des données, de l’infrastructure et de l’autonomie des enseignant·e·s dans le contexte des nouvelles technologies.

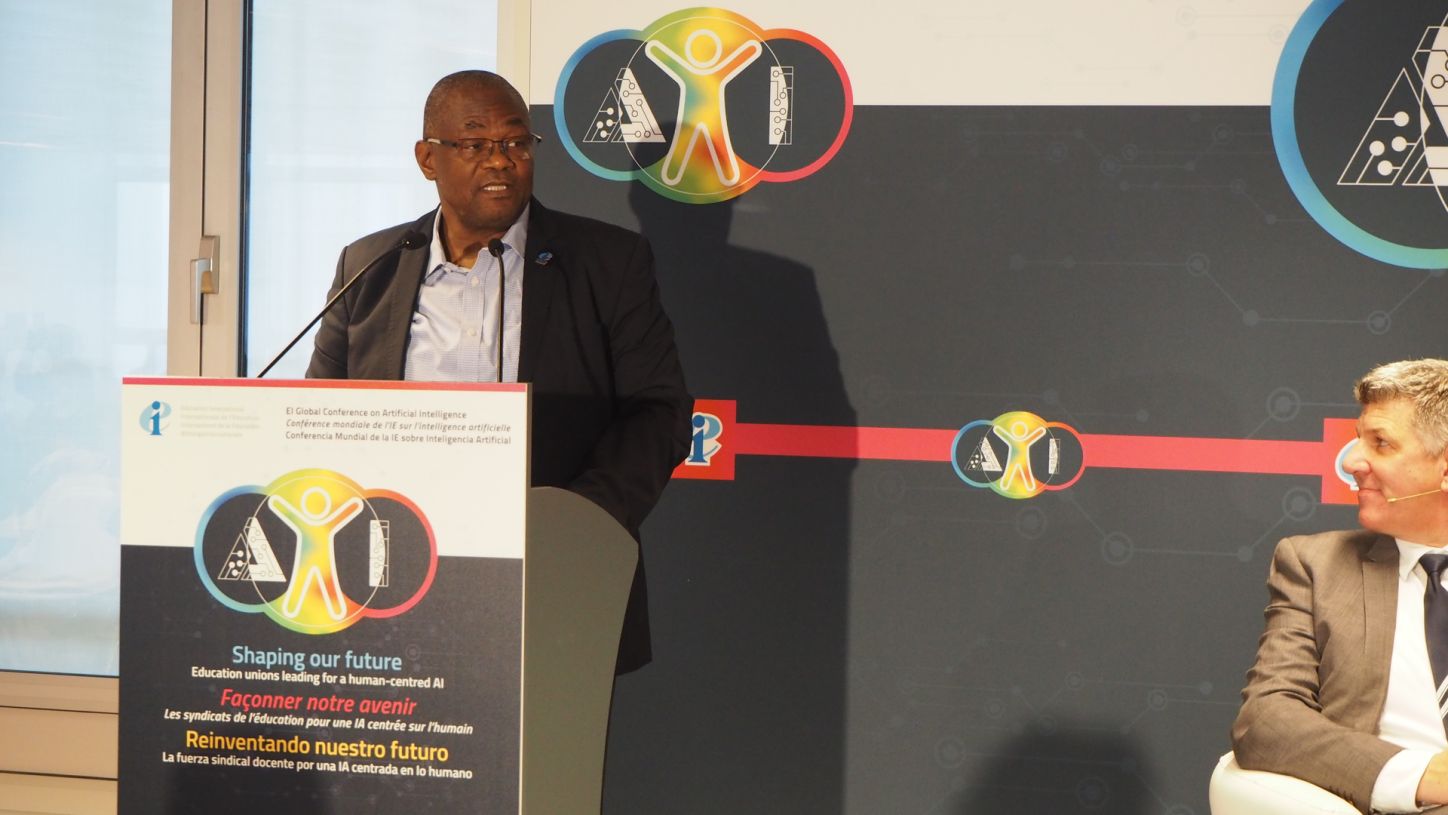

Le président de l’IE, Mugwena Maluleke, a souligné que l’IA ne peut en aucun cas remplacer la relation humaine au cœur de l’éducation.

« Si la technologie est l’outil, l’humanité est l’auteure. Un chatbot peut répondre à une question, mais seule la voix d’un enseignant ou une enseignante peut dire : “Je crois en toi”. L’innovation doit servir l’humanité, et non la restreindre. L’IA doit amplifier nos voix, et non se substituer à elles. »

Mise en contexte :la réalité de l’IA et son impact

Dans leur discours liminaire conjoint, le professeur Wayne Holmes, de l’UCL Institute of Education, et la professeure Kyungmee Lee, de la Seoul National University, ont présenté un aperçu critique de la manière dont l’IA est déployée dans l’éducation et des incidences que cela a sur les étudiant·e·s, les enseignant·e·s et les sociétés.

Le professeur Holmes a fait remarquer que les affirmations actuelles sur l’IA dans l’éducation tendent à se focaliser sur l’efficacité et la « personnalisation», mais font fréquemment abstraction des coûts cachés pour les enseignant·e·s et les apprenant·e·s.Il a montré comment, très souvent, l’IA modifie la charge de travail des enseignant·e·s, plutôt qu’elle ne la réduit : le temps est déplacé vers la création de prompts, la vérification et la réécriture des résultats, la gestion des données et de la vie privée, la gestion des risques éthiques et la réponse aux tentatives des élèves d’exploiter les faiblesses de l’IA. Parallèlement, certains systèmes éducatifs expérimentent des modèles sans enseignant·e·s ou avec un nombre réduit d’enseignant·e·s, soulevant de sérieuses préoccupations en termes d’autonomie professionnelle, de responsabilité et de qualité.

M. Holmes a, par ailleurs, souligné les coûts environnementaux de l’IA et la fracture grandissante entre les personnes qui ont accès à des systèmes puissants et celles qui n’y ont pas accès. Une maîtrise significative de l’IA doit, selon lui, inclure non seulement les dimensions technologiques et pratiques, mais aussi la dimension humaine : comprendre l’IA comme un système sociotechnique ayant des implications pour les droits, la démocratie et la planète.

La professeure Kyungmee Lee, pour sa part, s’est appuyée sur les recherches menées en Corée du Sud sur la réforme des manuels scolaires numériques (AI Digital Textbook – AIDT) pour illustrer les politiques de numérisation à grande échelle et descendantes. Annoncée comme un moyen de « personnaliser» l’apprentissage et de moderniser les salles de classe, l’initiative AIDT a suscité une vive résistance de la part des enseignant·e·s, des parents et de la société civile. Les préoccupations allaient des coûts excessifs, de la protection des données et de la commercialisation, à la surutilisation du numérique, aux inégalités et à l’absence de consultation sérieuse.

Les travaux de la professeure Lee montrent de quelle manière l’utilisation de l’IA dans l’éducation entraîne une réorganisation des relations au sein de la classe : l’identité des élèves et les interactions entre pairs s’en trouvent modifiées, l’autorité et la visibilité des enseignant·e·s sont reconfigurées et de nouvelles strates de travail caché sont créées, alors que les éducateur·trice·s peinent à faire fonctionner les systèmes dans le contexte réel de l’école. L’IA, a-t-elle souligné, n’est pas simplement « introduite» dans l’éducation, mais résulte d’assemblages complexes de ministères, d’entreprises, d’infrastructures, de récits politiques et d’« informations concernant les enseignants et enseignantes». Les voix des enseignant·e·s, souvent marginalisées dans ces processus, doivent être remises au centre.

Perspectives syndicales : rien sur nous sans nous

Les responsables syndicaux·ales des différentes régions ont réfléchi aux réalités propres à leur contexte, qu’il s’agisse de marchés numériques fortement déréglementés ou d’environnements où le dialogue social et la réglementation jouent un rôle plus prépondérant.Il·elle·s ont illustré à l’aide d’exemples la manière dont les syndicats réagissent aux réformes induites par l’IA, que ce soit en négociant la protection des données et la charge de travail, en contestant la privatisation ou en défendant le financement public.

Plusieurs thèmes récurrents sont ressortis des séances plénières et des réunions en petits groupes :

- L’IA doit être au service des enseignant·e·s et non les contrôler : les participant·e·s ont accueilli favorablement les outils qui allègent les tâches administratives, mais ont mis en garde contre ceux qui sapent le jugement professionnel, augmentent la surveillance ou alourdissent la charge de travail. Le droit pour les enseignant·e·s de participer, de se retirer ou de refuser des systèmes contraires à l’éthique figurait au centre des préoccupations.

- Connaissances critiques en matière d’IA : les syndicats ont souligné que l’enseignement avec et sur l’IA exige une formation solide des enseignant·e·s, fondée sur les droits humains, la démocratie et une pédagogie saine.

- Équité et colonialisme des données : l’IA est développée en grande partie au sein d’entreprises et de centres géopolitiques puissants, à partir de données qui sont susceptibles d’exclure des communautés ou d’en donner une représentation faussée. En résultent une augmentation des préjugés et de la discrimination, ainsi que l’apparition de nouvelles formes de colonialisme numérique.

- Inclusion et handicap : les outils d’assistance informatique basés sur l’IA peuvent aider les apprenant·e·s divers·es, mais doivent être évalués à l’aune de l’équité, des droits et d’une participation significative.

- Fractures numériques : la disparité des infrastructures, des modèles commerciaux et des régimes de licence engendre de nouveaux clivages au sein des pays et entre eux. Les syndicats ont appelé à l’investissement public et à la résistance à la dépendance vis-à-vis des plateformes privées.

Au terme de la première journée de la conférence, le professeur Punya Mishra, directeur de Innovative Learning Futures à l’Arizona State University, a prononcé une allocution de clôture qui a suscité la réflexion. Il a exhorté les participant·e·s à dépasser le battage médiatique et à reconnaître l’IA pour ce qu’elle est : un système probabiliste qui produit un texte plausible mais dépourvu d’une réelle compréhension. « L’IA est capable de créer du contenu, mais pas du contexte», a-t-il fait remarquer.

M. Mishra a averti que l’éducation entrait dans une phase expérimentale mondiale non réglementée, celle d’un colonialisme des données, qui risque de renforcer les chambres d’écho et de réduire les espaces pour un dialogue humain authentique. Son message principal était clair :les éducateur·trice·s doivent aborder l’IA de manière réaliste et ne pas accorder une confiance aveugle aux promesses des entreprises.

De l’analyse à l’action : s’organiser pour l’avenir que nous voulons

Au cours de la deuxième journée de la conférence, l’accent s’est déplacé sur l’action. Les conversations sont passées de la critique à la stratégie, tandis que les responsables syndicaux·ales ont exploré la manière de traduire les principes en pouvoir par le biais de la négociation collective et de l’organisation.

Les sessions en petits groupes ont abordé certaines des priorités syndicales les plus pressantes à l’ère de l’IA. Les participant·e·s ont examiné comment les conventions collectives peuvent protéger contre la déqualification, la perte d’emploi et la surveillance incontrôlée, tout en fixant des limites claires à l’utilisation des données et à la prise de décision automatisée. La discussion a porté sur les façons innovantes dont les syndicats utilisent les outils numériques et les outils basés sur l’IA pour impliquer les membres, toujours dans le plein respect de la vie privée, de la démocratie et des droits des travailleur·euse·s. Enfin, les sessions ont examiné comment les normes mondiales, y compris les recommandations Organisation internationale du Travail (OIT)/UNESCO concernant la condition du personnel enseignant, doivent évoluer pour tenir compte des nouvelles réalités telles que le travail en plateforme, la gouvernance des données et la gestion algorithmique.

Lors d’une session en présence d’organisations internationales telles que l’UNESCO, l’Organisation de coopération et de développement économiques (OCDE), l’UNICEF et le Partenariat mondial pour l’éducation, les panélistes ont mis en garde contre un vide politique grandissant, à l’heure où l’IA progresse bien plus rapidement que les réglementations ou les données probantes. Les panélistes ont souligné l’importance de la précision par opposition au battage médiatique, notant que de nombreux outils déployés dans les salles de classe ont été conçus à des fins commerciales et non d’apprentissage, et qu’ils s’appuient trop souvent sur des données de formation provenant quasi-exclusivement des pays du Nord global. De ce fait, de nombreux pays, langues et réalités scolaires ne sont pas pris en compte dans la conception de ces systèmes. Les organisations ont souligné que les révisions en cours des normes mondiales offrent une occasion unique de réaffirmer le rôle central de la profession et de veiller à ce que l’IA s’adapte à l’éducation, et non l’inverse.

Un message clair est ressorti de toutes les interventions : les enseignant·e·s doivent garder le contrôle de l’utilisation pédagogique de l’IA et seule une approche centrée sur l’enseignant·e est à même de garantir que l’IA renforce l’enseignement public au lieu de le saper.

Les réunions régionales ont permis aux organisations membres de formuler des engagements en vue de travaux futurs sur l’IA dans l’éducation. Ceux-ci vont de campagnes nationales en faveur d’une législation solide sur la protection des données et l’IA dans les écoles à des groupes de travail régionaux sur l’IA, en passant par des programmes de recherche communs et des programmes de formation conjoints à l’intention des militant·e·s syndicaux·ales.

Au cours de la deuxième journée de la conférence, l’attention s’est aussi portée sur l’importance d’un front uni et l’élaboration de stratégies et de principes communs pour la négociation des réglementations en matière d’IA, afin de garantir que le mouvement syndical mondial de l’éducation parle d’une seule voix. Les universités ont été identifiées comme des partenaires clés dans l’élaboration de cadres éthiques. Les participant·e·s ont également insisté sur la nécessité de la diversité dans la prise de décision. Le consentement préalable, libre et éclairé doit guider tout développement de l’IA impliquant des communautés autochtones, en protégeant la propriété intellectuelle et spirituelle et en établissant des garanties claires. Les syndicats ont la responsabilité d’informer leurs membres, de leur fournir une formation et de développer le langage nécessaire pour leur permettre de participer avec assurance aux négociations collectives sur l’IA.

Nous ne sommes pas des passager·ère·s de l’avenir, nous en sommes les architectes

Le secrétaire général de l’IE, David Edwards, a présenté cinq piliers stratégiques qui guideront le travail de l’IE sur l’IA :

- Organiser un réseau mondial pour relier les syndicats,

- Mettre en commun les travaux de recherche les plus récents,

- Mener des actions de plaidoyer aux niveaux international et national,

- Renforcer les capacités syndicales par la formation et l’organisation, et

- Assurer un leadership intellectuel afin que les enseignant·e·s et l’éducation centrée sur l’humain restent au cœur des politiques et des pratiques.

Ces piliers façonneront la stratégie à long terme de l’IE, afin que la technologie agisse au service de l’humanité et renforce les systèmes d’enseignement public.

La conférence s’est clôturée par un appel à l’action marquant u président de l’IE, Mugwena Maluleke, qui a rappelé aux délégué·e·s que l’éducation doit rester une entreprise éminemment humaine. « À l’ère des algorithmes et de l’automatisation, nous sommes la lumière – la sagesse humaine qui éclaire la voie à suivre. Même si l’IA est capable de traiter des données, elle est dépourvue de discernement, de jugement et d’humanité. C’est là notre don, notre vocation », a-t-il déclaré.

M. Maluleke a exhorté les syndicats à s’organiser, à plaider et à éduquer pour que la technologie soit au service de l’humanité, et non l’inverse. « L’humain d’abord. Toujours. Les enseignants et enseignantes guident. La technologie sert. L’éducation unit », a-t-il déclaré, appelant les éducateur·trice·s du monde entier à défendre l’autonomie professionnelle, la sécurité de l’emploi et la dignité de l’enseignement à l’ère de l’IA.

À la clôture de la conférence, une conviction claire et unanime s’est dégagée : l’IA est certes puissante, mais ce sont les éducateur·trice·s organisé·e·s, ancré·e·s dans l’éthique professionnelle, la solidarité et l’engagement pour la démocratie, qui détermineront l’avenir de l’éducation.

Vous pouvez accéder aux conclusions de la conférence ici.